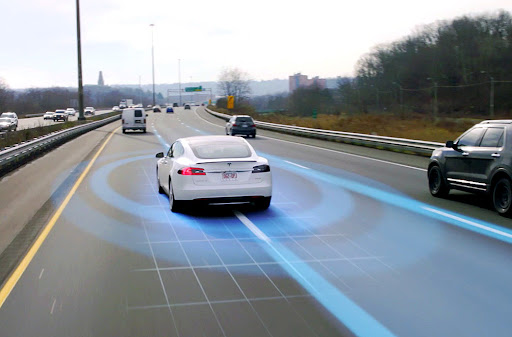

سیستم نیمه خودران اتوپایلوت تسلا مدتهاست که تحت انتقاد شدید قرار دارد. جدیدترین گزارش، یک سری ویدیویی از وال استریت ژورنال، تصاویری از چندین تصادف را نشان میدهد که گفته میشود با استفاده از سیستم اتوپایلوت مرتبط هستند. ژورنال نتیجهگیری میکند که اتکا به سنسورها و دوربینهای کامپیوتری به جای لیدار یکی از دلایل مشکلات آن است.

با وجود تحقیقات اداره ملی ایمنی ترافیک بزرگراهی (NHTSA) درباره حالت رانندگی نیمه خودران بحثبرانگیز اتوپایلوت، تسلا با هیچ عواقب جدی روبرو نشده است. مدلهای جدید و قدیمی تسلا همچنان با فناوری که اگرچه از نظر فنی یک حالت رانندگی نیمه خودران سطح 2 SAE است، اما میتواند به عنوان یک سیستم کاملاً خودران مورد سوء استفاده قرار گیرد، در خیابانها و بزرگراههای شهری تردد میکنند.

از این رو، بحث بر سر نام اتوپایلوت و یکی از دلایل تحقیقات بیشمار دولت فدرال و رسانههای خبری درباره تسلا وجود دارد. آخرین تحقیقات وال استریت ژورنال تلاش میکند تا مشخص کند چرا برخی از تسلاها تصادف کردهاند.

ویدیوی تقریباً 11 دقیقهای WSJ که برای مشاهده نیاز به اشتراک دارد، دومین قسمت از سری است که سیستم اتوپایلوت تسلا را زیر ذرهبین قرار میدهد. این ویدیو علت برخی از تصادفات را به اتکای بیش از حد اتوپایلوت به بینایی کامپیوتری مرتبط میکند که اساساً روشی برای آموزش کامپیوترها برای درک اطلاعات بر اساس ورودیهای دیجیتال مانند ویدیو است.

بیش از هزار تصادف تسلا به NHTSA گزارش شده است

خودروسازان آمریکایی از زمان صدور دستور عمومی NHTSA در مورد گزارش تصادفات در ژوئن 2021، مجبور شدهاند تمام تصادفات جدی دنیای واقعی شامل سیستمهای رانندگی خودکار سطح 2 یا بالاتر SAE را گزارش کنند. طبق گزارشها، تسلا از سال 2016 تاکنون بیش از 1000 تصادف را به NHTSA ارسال کرده است، اما WSJ ادعا میکند که بیشتر این دادهها از دید عموم پنهان است زیرا تسلا آن را مالکیت انحصاری میداند. با این حال، این رسانه خبری میگوید با جمعآوری گزارشها از ایالتهای مختلف و مقایسه متقابل آنها با دادههای تصادف که تسلا به NHTSA ارسال کرده است، این مشکل را حل کرده است.

در میان 222 تصادفی که WSJ میگوید برای این گزارش کنار هم گذاشته است، این روزنامه اعلام کرد که 44 مورد زمانی رخ داده است که یک تسلا با فعال بودن اتوپایلوت ناگهان منحرف شده است، در حالی که 31 تصادف دیگر گزارش شده است که زمانی اتفاق افتاده است که اتوپایلوت نتوانسته است برای مانعی تسلیم یا توقف کند. گفته میشود حوادثی که تسلا نتوانسته متوقف شود منجر به شدیدترین جراحات یا مرگ میشود. WSJ از کارشناسان خواست تا یک تصادف مرگبار را تجزیه و تحلیل کنند که در آن اتوپایلوت یک کامیون واژگون شده در بزرگراه را تشخیص نداد و خودرو به آن برخورد کرد.

این چیزی است که برخی از کارشناسان مصاحبه شده توسط ژورنال آن را شاهدی بر بزرگترین نقص اتوپایلوت میدانند. برخلاف برخی از خودروسازان دیگر که از بینایی کامپیوتری رادار و تصویربرداری لیزری لیدار برای تشخیص اشیاء استفاده میکنند، تسلا عمدتاً به بینایی کامپیوتری مبتنی بر دوربین با رادار به عنوان پشتیبان در برخی مدلها تکیه میکند. جان برنال، که در سال 2022 به دلیل انتشار فیلمهای شکست اتوپایلوت از تسلا اخراج شد، به WSJ میگوید که متوجه شده دوربینهای استفاده شده در برخی مدلهای تسلا به درستی کالیبره نشدهاند. او میگوید که وقتی دوربینها چیز یکسانی را نمیبینند، میتوانند در شناسایی موانع مشکل داشته باشند. و همانطور که تحقیقات نشان میدهد، تکیه بیش از حد تسلا بر دوربینها برای کنترل اتوپایلوت میتواند منجر به تصادف شود.

منبع: caranddriver

تیم ترجمه و نگارش دل افکار